让AI去学习AI:你已经是个成熟的模型了,该学会自己训练了

文章插图

文章插图

随着深度神经网络的不断发展 , 各种模型和新颖模块的不断发明利用 , 人们逐渐意识到开发一种新的神经网络结构越来越费时费力 , 为什么不让机器自己在不断的学习过程中创造出新的神经网络呢?

正是出于这个构思 , 2017年Google推出了AutoML , 一个能自主设计深度神经网络的AI网络 。

自此 , 人工智能又有了更进一步的发展 , 人们开始探索如何利用已有的机器学习知识和神经网络框架来让人工智能自主搭建适合业务场景的网络 , 人工智能的另一扇大门被打开 。

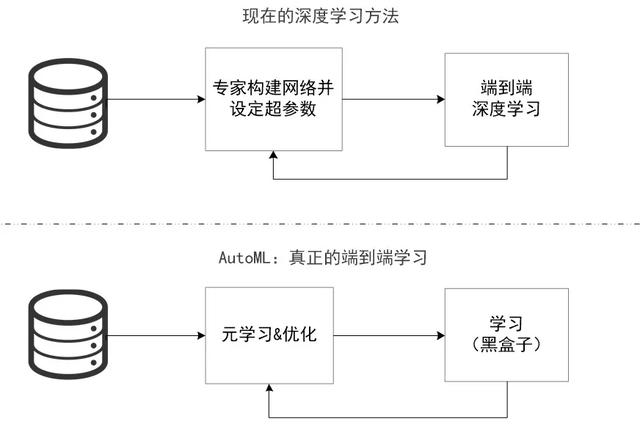

01 深度学习vs自动化深度学习随着深度神经网络的广泛应用和不断发展 , 越来越强大的网络模型被构建 , 从AlexNet , 到VGGNet , GoogleNet以及ResNet 。

虽然这些模型足够灵活 , 但人工神经网络结构仍然需要大量的专业知识并且需要充足的时间 , 而且调参对于深度模型来说也是一项非常痛苦的事情 , 众多的超参数和网络结构参数会产生爆炸性的组合 。

是否有可能使这一过程自动化 , 让每一个人 , 甚至是不了解机器学习的人可以轻松地将机器学习应用于所面临的问题 , 自动化深度学习(AutoDL)就是答案 。

如图1所示 , 是现在的深度学习方法与自动化深度学习的对比图 , 自动化深度学习的目标是通过超参数优化的方法让机器学会自动设计网络及调参优化 。 文章插图

文章插图

▲图1 传统深度学习与AutoDL比较

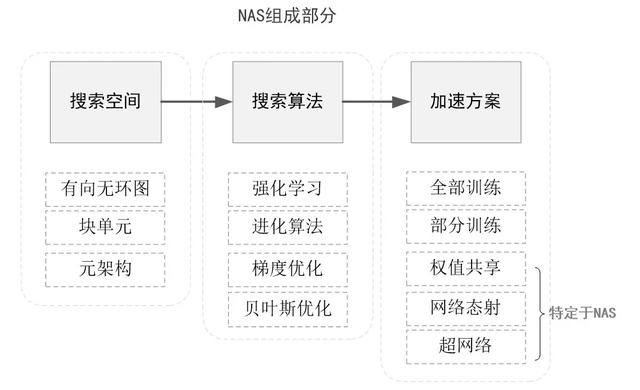

02 什么是神经架构搜索(NAS)神经架构搜索(NAS)是一种针对特定数据集从头开始自动设计性能良好的模型的技术 , NAS技术与超参数优化所解决的问题相同:在搜索空间中找到对目标任务表现良好的网络结构 。

NAS主要由三个基本问题组成 , 分别是搜索空间、优化方法、以及评估方法 。

- 搜索空间针对目标任务定义了一组可能的神经网络结构 。

- 优化方法确定如何探索搜索空间以找到好的架构 。

- 评估方法评估通过优化方法考虑的每种网络结构的性能 。

文章插图

文章插图▲图2 NAS组件

1. 搜索空间如其名 , 就是可供搜索的一个网络结构集合 , 它的数字表示为:

- 网络的结构(如:神经网络的深度 , 即隐藏层个数 , 和特定的隐藏层宽度)

- 配置(如:操作/网络间的链接类型 , 核的大小 , 过滤器的数量)

好的搜索空间为好的搜索结果提供可能性 , 搜索空间的设计不断发展 , 除了传统的链式结构外 , “多分支”结构也开始起着越来越重要的作用 , 启发于ResNet和DenseNet提出的跳跃连接和密集连接 , 这些跳跃连接也已经被加入到搜索空间的定义中 。

另一个趋势是设计一个只包含一个基本单元(cell)搜索空间 , 被用作整个网络中的block(如卷积块)的构建 。 这类搜索空间被称为micro(微)搜索空间 , 其中搜索成本和复杂性可以被显著的降低 。

除了减小搜索复杂度外 , 仅仅通过改变单元(cell)堆叠的数量 , 可以很容易地把找到的最好的block的设计推广到其他任务 。

2. 搜索算法搜索算法是一个迭代过程 , 用于确定以何种规则来探索搜索空间 。

在搜索过程的每个步骤或迭代中 , 一个来自于搜索空间的样本会被生成 , 即子网络(child network) 。 所有的子网络在训练集上被训练 , 在验证集上的准确率作为目标被优化(或者是强化学习中的奖励) 。

搜索算法的目的是找到最佳子网络 , 例如最小化验证集损失或最大化奖励 。 主流的NAS搜索策略大致可以分为强化学习、进化算法和可微分的梯度下降算法 。

1)基于强化学习的方法

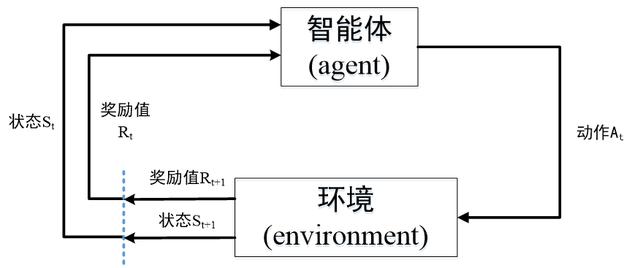

强化学习有三个基本要素:智能体(Agent)、环境(Environment)和奖励(Reward) , 智能体以 “试错”的方式进行学习 , 通过与环境交互获得奖励来指导行为 。 智能体和环境之间的交互可以被视为顺序决策过程:在每个时间t , Agent在动作集合中选择动作与环境交互并接收奖励 。

文章插图

文章插图

- 空调|让格力、海尔都担忧,中国取暖“新潮物”强势来袭,空调将成闲置品?

- 手机|这个超强App,让手机快3倍,流畅到起飞

- 速度|华为P50Pro或采用很吓人的拍照技术:液体镜头让对焦速度更快

- 蛋壳公寓|官媒发声:绝不能让“割韭菜者”一跑了之!

- 健身房|乐刻韩伟:产业互联网中只做单环节很难让数据发挥大作用

- 绝不能|互联网也有“五连鞭”毒瘤,绝不能让这些“割韭菜者”一跑了之

- 跑腿|机器人“小北”上岗 让办事群众少跑腿

- 涡轮|看法米特涡轮流量计如何让你得心应手

- 手机|新鲜评测:让手机变身电脑的显示器见过没?只用4步即可完成!

- 生态位|“淘品牌”已去,“播品牌”正红