心怀|人脸识别登上Nature封面!看脸的世界,AI却心怀偏见( 二 )

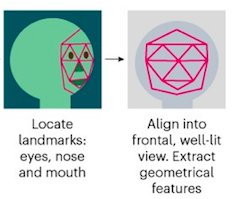

接下来的任务是将面部「正常化」 ,人为地将其旋转成一个正面、光线充足的图像。这样就产生了一组面部特征,可以与从现有的面部数据库中提取的特征进行比较。这通常包括在受控条件下拍摄的照片,比如警察的哑照。由于特征表示是紧凑的、结构化的文件,计算机可以快速扫描数以百万计的文件以找到最接近的匹配。

文章插图

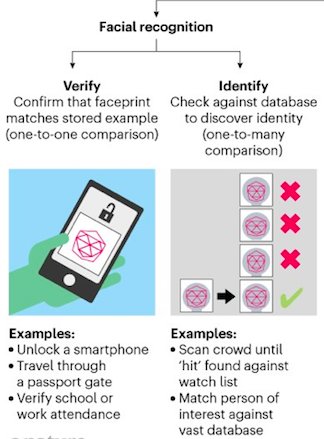

将人脸与大型数据库(称为一对多识别)进行匹配是人脸识别系统的两种主要类型之一。另一个是一对一的验证,这是一个相对简单的任务,确保一个人符合自己的照片。它可以应用于任何事情,从解锁智能手机到国家边境的护照检查。

文章插图

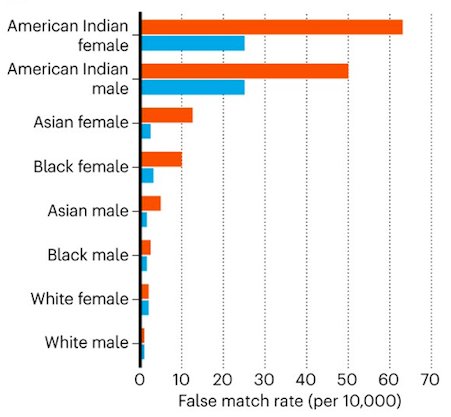

在进行了一些对比试验后,得出结论: 大多数数据包对白人男性面孔的准确度往往高于对有色人种或女性面孔。特别是,在数据库中被归类为非洲裔美国人或亚洲人的面孔,被错误识别的可能性是被归类为白人的面孔的10-100倍。女性也比男性更容易出现假阳性。

文章插图

另外,户外、光线不好或者图像颗粒状可能会影响匹配率。

「电脑说是你」,真假面孔谁来定?在一对一的验证方面,例如确认护照或智能手机的合法拥有者,人工智能已经变得极其准确,甚至与眼睛最敏锐的人类一样娴熟。

在这个领域,前沿的研究目前集中在侦测恶意攻击上。例如,用于解锁手机的面部识别系统,很容易被照片欺骗。

「3D 面部识别效果更好。」Jain 说,「但现在最大的挑战是高质量的面具。」在一个项目中,Jain 和他的合作者正在通过运用皮肤纹理来检测出「假面孔」。

但是,正如默里所发现的那样,一对多的验证却并没有想象中那么简单。尽管有了足够多的观察名单,但被标记为假阳性的数量很容易超过真实的结果。

今年一月在英国加的夫举行的一场足球比赛中,抗议面部识别的横幅(在2019冠状病毒疾病流感大流行之前)。

当警察通过面部识别监测犯罪行为,必须迅速做出阻止某人的决定时,这个问题就显现出来。而在缓慢的调查中,面部识别同样也会发生错误。

文章开头所说的威廉姆斯被警察的面部识别办案系统误判的事情,就是一个典型的例子。

美国公民自由联盟的律师菲尔 · 梅耶尔认为,这项技术应该被禁止。「这种方法行不通,即使它行得通,对于政府来说,如果没有令人信服的结果,用这种方法来监视自己的公民仍然是非常危险的。」

在美国公民自由协会的投诉发生后不久,底特律警察局长詹姆斯 · 克雷格承认:如果该软件单独使用,「96% 的情况下」会错误识别案件。

出于对种族偏见和歧视的担忧,在过去的18个月里,至少有11个美国城市禁止公共部门进行面部识别。但底特律警方仍在使用这项技术。

2019年底,警方采取了禁止直播监控的政策,并且规定只对静态图像和用于刑事调查的一部分动态图像使用该软件。

「而威廉姆斯是在该政策实施前被捕的」克雷格在6月份时说。

文章插图

面部识别分析的其他方面研究,比如试图根据一个人的面部表情推断出他的性格,则更具争议性。

研究人员已经证明,这种方法并不奏效ーー即使是最好的软件也只能根据人猜测的图像进行训练。

但是世界各地的公司仍然在购买未经证实的技术,这些技术被一些企业用在面试中,根据求职者谈话的视频评估求职者的个性。

阿利坎特的计算机科学家纽里亚 · 奥利弗认为,政府应该规范面部识别和其他潜在技术的使用,以防止滥用。

奥利弗是一家名为欧洲学习与智能系统实验室(European Laboratory for Learning and Intelligent Systems)的区域网络的联合创始人兼副总裁。他表示:

「系统在未经适当评估其性能,没有经过验证和再现性的情况下就被广泛使用,后果是难以预测的。」

「面部识别」滥用带来对隐私、道德和人权的担忧一些法规提案要求当局建立准确性标准,并要求人类审查任何算法的结论。

但是,渥太华互联网基金会 Mozilla 的技术研究员、专门审计面部识别系统的德博拉?拉吉(Deborah Raji)表示:基于 NIST 基准的标准本身太低,不足以证明部署该技术是合理的。

文章插图

- 二维码|村网通?澳大利亚一州推出疫情追踪二维码 还考虑采用人脸识别和地理定位

- 首创|网易有道词典笔3发布:首创毫秒级超快点查、识别率超98%

- NIST测试显示人脸识别系统对蒙面人的识别能力越来越强

- 人脸识别|10元能买600张人脸照片 “刷脸”真的安全吗?

- 合同|人脸识别,“必要性”标准有待细化

- 网易有道词典笔3发布:首创毫秒级超快点查、识别率超98%

- 如何系统地欺骗图像识别神经网络

- 简单的BP网络识别液晶中的数字实验

- 人脸追踪、双目活体对齐!系统梳理人脸识别开发的硬核技巧

- 国外进行特斯拉Autopilot测试 连投射的人影都能识别