按关键词阅读:

【学习机器学习背后的高级数学】全面的资源列表 , 用于学习机器学习的高级数学

文章插图

文章插图

> Photo by Thought Catalog on Unsplash

数学是大多数机器学习算法的基础 。 因此 , 必须掌握一定的数学知识以理解机器学习 。 尽管大多数数据科学家都知道基本的数学概念 , 例如线性代数 , 统计等 , 但其中许多人并不了解一些深奥的数学概念 , 这些概念可以帮助他们更清楚地了解算法的工作方式或使他们能够了解机器学习的最新研究 。

在本文中 , 我共享了高级数学课程的资源 , 这些课程有助于机器学习 。 本文讨论的主题是凸和非凸优化 , 信息论 , 概率图形模型等 。

给出了资源清单 , 以使其假定读者熟悉基本概念 , 例如线性代数 , 概率论 , 多变量微积分和多变量统计 。 了解这些基本主题对于理解本文介绍的高级课程中介绍的材料至关重要 。

本文中的资源可用于启动博士学位 。学位 , 期望学生全面了解与研究主题相关的数学概念 。

该计划主要分为以下几部分:

· 凸优化

· 概率图形模型

· 非凸优化

· 信息论

该列表永无止境 , 但是我在这里讨论的以下四个主题对于机器学习至关重要 , 并且可以高度转移到其他工程领域 。

充分利用资源:· 即使您知道其内容 , 也建议不要参加任何讲座 。这些讲座可以用来修改概念 。

· 观看讲座时做手写笔记 。它有助于更好地理解并有助于记忆概念 。

· 练习书籍或课程作业中给出的问题 。如果存在许多类似的问题 , 请针对每种类型执行1-2个问题 。

· 在本书的每个讲义/章节之后 , 请尝试导出所讨论的定理/证明并进行相应的修订 。

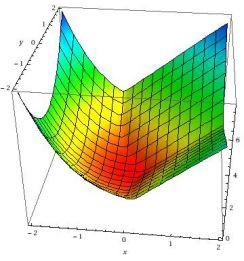

凸优化: 文章插图

文章插图

> +Optimization.html

机器学习中的大多数方法都是基于找到使某些目标函数最小化的最佳参数 , 例如二进制交叉熵 , 均方误差等 。 由于这个事实 , 大多数机器学习问题都可以视为优化问题 。 使用凸优化 , 一些机器学习算法可以简化分析并确保解决方案的唯一性 。 凸优化用于许多工程领域 , 并且是任何工程学位的基本主题之一 。

学习该主题的最经典的书是Stephen Boyd博士和Lieven Vanderberghe博士的凸优化书 。世界各地的不同大学也提供非常出色的讲座 。其中一些列出如下:

· Stephen Boyd博士在YouTube上的讲座

· CMU 10–725在YouTube上的讲座

· Joydeep Dutta教授在NPTEL上进行的凸优化

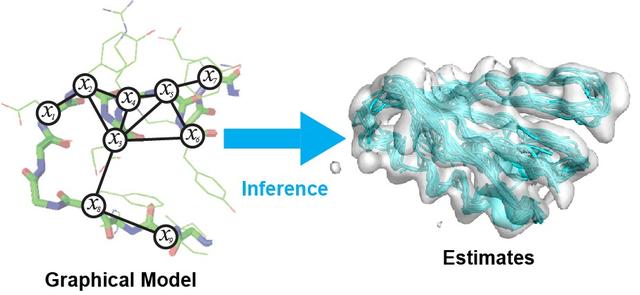

概率图形模型: 文章插图

文章插图

> ~pachecoj/courses.html

概率图形模型提供了一种数学方法来编码图中随机变量之间的概率关系 。 通常 , 图中的节点是变量 , 并且边编码它们之间的概率独立性或依赖性 。 在大多数现代机器学习研究中 , 许多机器学习模型都是用图形模型定义的 。 此方法用于描述模型基础的概率推断的结构 。 它也用于其他领域 , 例如生物学 , 金融等 。

Daphne Koller和Nir Friedman编写的概率图形模型是学习PGM的标准书 。 除了这本书 , 还有一些关于PGM的漂亮课程 , 如下所示:

· Tom Mitchell博士和Lella Wehbe博士的CMU 10701讲座 。 是博士水平课程 。

· 斯坦福大学的Daphe Koller博士在Coursera上提供了概率图形模型专业化课程 。

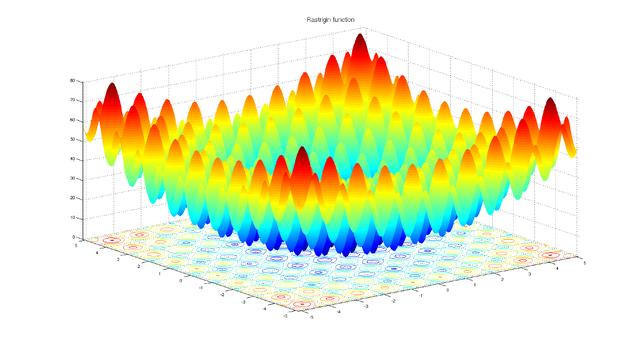

非凸优化: 文章插图

文章插图

> :Rastrigin_function.png

与凸优化相比 , 非凸是一个相对较新的领域 , 在诸如神经网络的算法中至关重要 。使用凸优化技术解决非凸问题会导致局部最优而不是全局最优 , 这是深度学习模型中最大的问题之一 。非凸问题具有许多可行且非常平坦的区域 , 曲率变化很大 , 每个区域中有多个鞍点 。

由于非凸优化不是既定领域 , 仍然是活跃的研究领域 , 因此几乎没有足够的资源可用于非凸优化 。最好的阅读资源是Prateek Jain博士和Purushottam Kar博士的"机器学习的非凸优化" 。没有任何课程会详细介绍非凸面优化 。最好的视频资源是在NIPS 2015研讨会上关于非凸优化的演讲 。

信息论: 文章插图

文章插图

> istock.com

信息论与机器学习有着牢固的关系 。许多机器学习算法中使用的交叉熵损失是信息论的直接应用 。决策树还使用信息论的概念(例如熵 , 互信息等)在树数据结构中拆分节点 。信息理论还用于数据压缩 , 信号处理 , 信息检索 , 数据挖掘等 。

稿源:(未知)

【傻大方】网址:http://www.shadafang.com/c/111J2WV2020.html

标题:学习机器学习背后的高级数学