贾磊畅谈AI语音技术的现在、过去和未来( 三 )

文章插图

文章插图

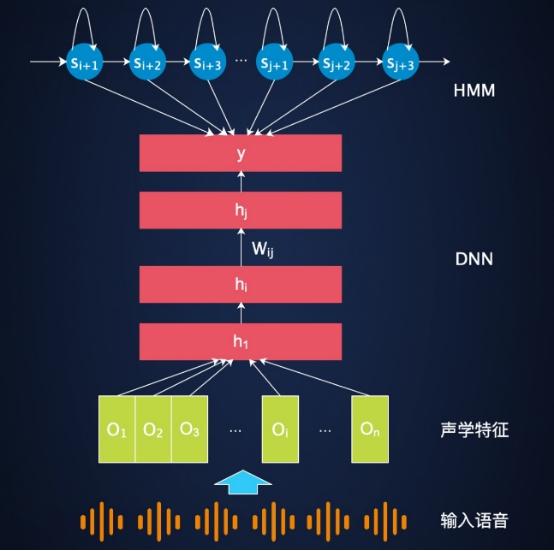

深度学习首次应用语音识别的系统框图

2011年, 微软的邓力和俞栋两位学者通力合作, 把深度学习技术应用于工业级的大词汇量连续语音识别实验, 获得相对于传统基线系统 23% 的显著提升 , 这标志着语音识别技术最先迎来深度学习革命 。 深度学习应用于语音识别 , 最初的整体建模框架仍然是 HMM , 但是声学输出分布 GMM 模型被替换成了深度学习 DNN 模型 。 这时候的语音识别系统是一种 HMM 和 DNN 混合 (hybrid) 的语音识别系统 。 随着深度学习技术在语音技术中越来越深入的应用 , 从 DNN 到 CNN , 再到 CNN+LSTM , 语音识别系统的字错误率以每年 10%- 15% 的相对错误率降低 。 再后来伴随着 CTC 技术的引入 , 更大粒度的建模单元(WordPiece 模型 , 音节和字)开始逐渐越来越多的被采用 , 应用于语音识别几十年的 HMM 框架逐渐被淘汰 。

语音识别技术进入端到端时代

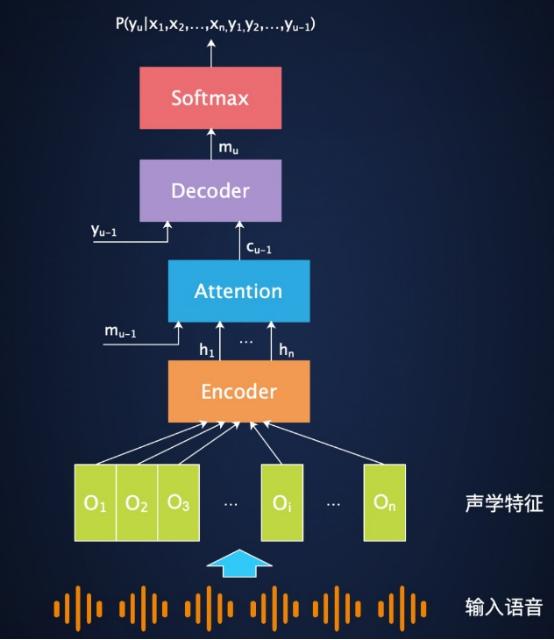

从 2015 年开始到 2020 年这段时间 , 注意力建模技术的研究 , 又让语音识别技术开始进入端到端的时代 。 2019 年之前 , Attention(注意力) 技术早已经广泛应用于 NLP、图像等商业产品领域 。 但是语音识别领域 , 从 2015 年开始 , 实验室内就广泛进行了基于 Attention 的声学建模技术 , 也获得了广泛的成功 。 国际上通常用于语音识别的注意力模型有两种 , 一种是谷歌的以 LSTM 为基础的 LAS(listening attention and spelling) 模型 。 另外一种是基于 self attention 的 transformer 模型 。 这两种注意力模型在实验室的各种实验中 , 都能够显著提升语音识别系统的识别率 , 同时实现了一套深度学习模型 , 语音语言一体化的端到端建模 。 虽然注意力模型在实验室范围内获得巨大成功 , 但是应用于工业界的实际在线语音交互产品 , 还存在一系列的技术障碍 。 核心难题就是在线需要识别系统需要流式解码 , 而注意力模型需要拿到整段语音才能进行解码 , 会造成用户无法接受的识别延迟问题 。 所以注意力模型直到 2019 年初 , 都没有在工业在线语音交互中使用注意力模型做语音识别的成功案例 。 2019年1月 , 百度发布率先发布了基于流式置信度建模技术的语音输入法产品 , 首次提出流式多级截断的注意力模型 (SMLTA) , 这是国际上注意力模型在在线语音识别领域的大规模工业应用的首个成功案例 。 之后 , 流式注意力模型在学术界也开始进入广泛的研究 。 最近 , 语音识别应用中的逐渐集中到流式的 self-attention 建模 , 包括流式的 transformer 等 。 人类对于语音识别的核心技术提升的脚步从来没有停止过 。 文章插图

文章插图

基于注意力机制的语音识别端到端建模的通用框架

2015-2020年期间 , 智能音箱产业在中国乃至世界范围内 , 都得到巨大的发展和普及 。 在智能音箱使用场景下 , 目标声源距离拾音器较远 , 致使目标信号衰减严重 , 加之环境嘈杂干扰信号众多 , 最终导致信噪比较低 , 语音识别性能较差 。 为了提升远场语音识别准确率 , 一般会使用麦克风阵列作为拾音器 , 然后利用数字信号处理领域的多通道语音信号处理技术 , 增强目标信号 , 最终产生一路清晰信号 , 送给后面的语音识别系统进行语音识别 。 这时候数字处理信号系统和语音识别系统相互级联是主流的远场语音识别技术 , 这种级联技术也成为第一代智能音箱远场语音交互技术的主流技术 。 随后 , 语音学术界开始进行一系列的技术创新 , 从数字信号处理到语音识别一体化的端到端建模成为热点 。 这是一种创新的远场语音交互技术 , 一套深度学习模型打穿数字信号处理和语音识别两个领域 。 国际上 , Google 最先试图解决这个问题 。 谷歌的解决方案采用的深度学习模型结构 , 来自于类似于 filtering and sum 的数字信号处理思想 , 模型底部的结构设计 , 模拟了数字信号处理的多路麦克处理过程 。 在此之上 , 模型仍然是采用传统的近场语音识别的深度学习模型 。 该模型直接建立了从远场语音多路信号到识别文字之间的端到端的进行 。 百度团队针对远场语音识别的特殊需求 , 也提出了自己的基于复数 CNN 的远场端到端建模方案 , 并大规模应用于工业产品 。

语音技术从之前的云端竞争开始逐渐向端侧芯片延伸

2020年左右的AI芯片的发展 , 也对语音交互行业产生了巨大的推动作用 。 在AI技术快速普及的今天 , 算力已经成为推动 AI 行业发展的根本核心力量 。 2011年微软的科学家能够把深度学习应用于语音识别工业界 , 除了科学家的勤奋工作之外 , 更重要的背后的推手是GPU 。 没有 GPU 的算力支持 , 就不可能一个月完成数千小时的 DNN 模型训练 。 从2011年至今 , 英伟达的股价已经从十几美金 , 暴涨了几十倍 。 这一点充分证明了 AI 算力的价值 , 在语音识别行业 , 远场识别的兴起催生了 AI 语音芯片的发展 。 一颗芯片完成端侧信号处理和唤醒成为一个明显的市场需求 。 在智能音箱领域 , 这种 AI 语音芯片能够显著降低音箱的成本 , 并且提供更高精度的唤醒和识别能力 。 在汽车车载导航领域 , AI 语音芯片可以保证主芯片的负载安全 , 提升驾驶安全 。 各大语音公司都开始推出自己的语音芯片 , 语音技术从之前的云端竞争又开始逐渐的向端侧芯片延伸 。

- 华夏小康|百融云创语音技术获多项专利 “百小融”赋能金融机构加速数字化

- 淘宝|给双12做准备?淘宝突然上线新功能:居然能打语音电话了

- TT语音|产业蓬勃发展之际,“TT语音”们如何打好下半场“擂台赛”?

- 创投圈|跨所有语言?Meta发布新语音模型,简直能让全球人无障碍交流

- 中华新闻|讯飞输入法全新升级!AI语音输入取得新突破

- 语音助手|微软 Cortana 与亚马逊 Alexa 两家语音助手停止合作

- AirPods|女子误把AirPods当药吞,传语音信息听得见肠胃声

- 语音|微软发布最新语音合成模型Uni-TTSv3

- 高棉语|Facebook Messenger 50% 的语音流量来自柬埔寨

- 新一期|华为智慧语音新一期众测活动开启:小艺支持识别河南话等